수년 내 대규모언어모델(LLM) 대신 현실 세계를 이해하고 로봇 등을 조작할 수 있는 ‘월드모델(세계모형)’이 인공지능(AI) 분야 대세 기술로 자리잡을 것이라는 글로벌 석학의 전망이 나왔다. 피지컬(물리적) AI처럼 로봇과 웨어러블(착용형) 기기 등에 탑재돼 당장 일상과 산업 현장을 혁신할 수 있는 차세대 기술 확보에 집중해야 한다는 제언이다.

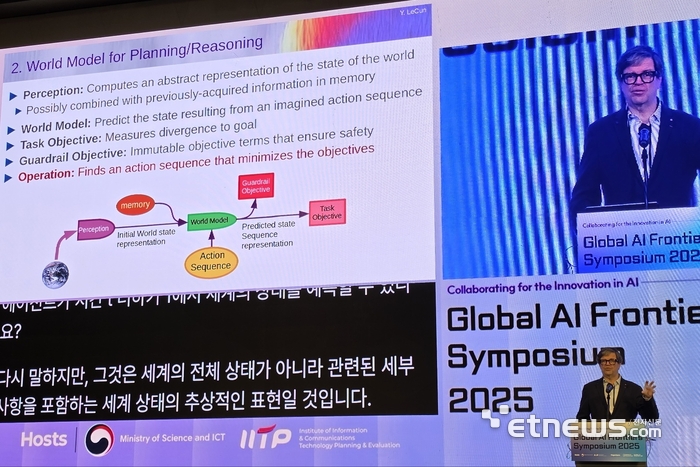

얀 르쿤 뉴욕대 쿠란트수학연구소 교수 겸 메타 수석AI과학자는 27일 서울 용산구 서울드래곤시티에서 열린 ‘AI 프론티어 국제 심포지엄 2025’ 기조강연을 맡아 “대규모언어모델(LLM)은 5년 내 구식 기술이 될 것이다”며 “인간 수준 AI 연구에 관심이 있다면 더이상 LLM에만 집중해서는 안 된다”고 강조했다. 그는 “우리에게 필요한 것은 물리적 세계를 이해하고 우리와 함께 일할 수 있는 AI 시스템인 월드모델”이라고 말했다.

최근 전 세계적으로 AGI 기술 개발이 앞다퉈 시도되고 있다. 챗GPT 같은 AI 에이전트(비서) 기술이 더 발전해 인간의 사고 능력을 완전히 모방할 수 있을 것이라는 비전이다. 우리 정부도 1조 원을 투입해 국산 AGI 기술을 확보한다는 계획이다. 하지만 이 같은 발전에는 한계가 있으며 이를 극복하려면 AI가 물리적 세계를 이해하는 능력을 집중적으로 보완해야 게 세계적 권위자의 생각이다. 르쿤 교수는 제프리 힌튼 토론토대 교수, 요슈아 벤지오 몬트리올대 교수, 앤드루 응 스탠퍼드대 교수와 함께 AI 분야 4대 석학으로 꼽힌다. 2018년 ‘컴퓨터과학계 노벨상’으로 불리는 튜링상을 받았다.

르쿤 교수는 구체적으로 현재 텍스트(언어) 중심의 LLM 학습 방식에 한계가 있다고 지적했다. 그는 “일반적으로 LLM은 30조 토큰, 환산하면 100조 바이트의 텍스트 데이터를 가졌다”며 “누구라도 이를 모두 읽으려면 50만 년은 걸린다”고 설명했다. 100조 바이트는 텍스트로는 이처럼 반대한 양이지만 인간은 시각·청각·촉각 등 여러 감각을 동원해 생후 4년, 즉 현실 세계를 단순하게나마 이해할 수 있는 4살짜리 아이 정도면 쉽게 습득할 수 있는 양이다.

첨단 AI가 복잡한 계산은 인간보다 훨씬 잘하지만 주변 환경을 인식하고 물체를 조작하는 단순한 일은 여전히 어려워하는 ‘모라벡 역설’을 해결할 실마리가 여기에 있다는 게 르쿤 교수의 생각이다. LLM을 넘어 이미지·소리 등 여러 유형의 데이터를 복합적으로 학습한 멀티모달(다중모델)이나 로봇 적용을 위한 피지컬 AI 기술이 필요하다는 것이다. 그는 “AI 시스템은 물리적 세계를 이해하는 능력에서 집고양이보다도 똑똑하지 못하다”며 “AI 시스템은 이제 텍스트 학습만으로는 안 되고 비디오 같은 감각 입력을 통해 물리적 세계를 스스로 학습할 수 있어야 한다”고 덧붙였다.

과학기술정보통신부는 이날 AI 프론티어 국제 심포지엄 2025를 개최하고 배경훈 장관이 직접 좌장을 맡아 르쿤 교수 등과 AI 국제협력 등을 주제로 토론을 진행했다.

![[기고] 실험실의 성과, 시장의 성공으로](https://img.etnews.com/news/article/2025/09/25/news-p.v1.20250925.432656152e5344bbb2a8c51ef9b8a42d_P3.png)