국내 휴머노이드 스타트업과 서울대학교가 손잡고 복잡한 장비 없이도 로봇을 쉽게 훈련시킬 수 있는 인공지능(AI) 모델을 개발했다. '피지컬 AI' 시대에 맞춰 국내 기술력을 기반으로 만든 세계적 수준의 기술로 주목받는다.

로보틱스AI 기업 투모로로보틱스는 12일 서울대와 공동 개발한 로봇 AI 모델 'CLIP-RT'를 공개했다.

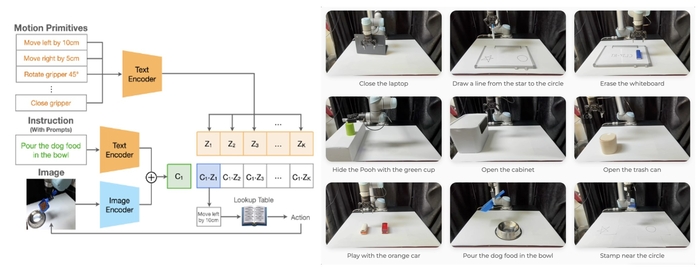

CLIP-RT는 사용자의 자연어 설명만으로 로봇에게 동작을 학습시키는 로봇 파운데이션 모델(RFM, Robot Foundation Model)로, 전문 장비나 원격 조작 없이도 일반인이 로봇을 쉽게 훈련시킬 수 있는 것이 특징이다.

CLIP-RT의 연구 결과는 로봇공학 분야 최고 권위 학회인 'RSS 2025'에 논문이 채택됐다. 해당 연구는 스탠퍼드대가 주도해 개발 중인 '오픈VLA(OpenVLA)-OFT', 피지컬인텔리전스의 '파이제로(Pi0)' 등과 함께 '비전-언어-행동(VLA)' 세션에서 나란히 발표될 예정이다.

세계적으로 주목받는 로봇 파운데이션 모델들과 어깨를 나란히 하게 되면서, 국내 기술의 국제 경쟁력이 입증됐다는 평가다.

CLIP-RT는 사용자가 “컵을 선반에 올려줘”라고 말하면 로봇이 이를 이해하고 동작을 수행한다. 기존에는 VR 장비나 전문가의 원격 조작이 필요했지만, CLIP-RT는 텍스트나 음성 명령 만으로도 새로운 작업을 학습시키는 것이 가능하다.

성능 면에서도 CLIP-RT는 세계 수준을 입증했다. 스탠퍼드대의 대표 모델 '오픈VLA'보다 높은 조작 성공률을 기록했으며, 파라미터 수는 약 10억개로 오픈VLA(약 70억개)의 7분의 1수준으로 훨씬 작지만, 평균 24%포인트 높은 성공률을 보였다. 특히 처음 수행하는 작업에서도 53%의 성공률을 기록해, 일반화 성능에서도 앞섰다.

또, 로봇 조작 모델 성능을 평가하는 글로벌 벤치마크인 '리베로(LIBERO)'에서도 92.8%의 성공률을 나타냈으며, 오픈VLA보다 약 39배 빠른 163㎐ 속도로 실시간 제어도 가능함을 입증했다. 한두 번의 시연만으로 새로운 작업을 학습할 수 있는 효율성도 뛰어나며, 일부 과제에서는 사용자 피드백 2~4회만으로 빠른 성능 향상을 보여줬다.

CLIP-RT 개발을 주도한 장병탁 투모로로보틱스 대표(서울대 AI연구원장)는 “국내 최초로 세계 수준의 로봇 파운데이션 모델을 개발한 의미 있는 성과”라며 “누구나 손쉽게 로봇을 훈련하고 활용하는 시대를 앞당기기 위해 CLIP-RT를 오픈소스로 공개하고 후속 연구를 이어갈 것”이라고 밝혔다.

이번 기술은 과학기술정보통신부, 산업통상자원부, 광주광역시 등의 지원으로 개발됐으며, 장병탁 원장와 함께 이준기 연구교수, 강기천 연구원, 김정현 박사과정 등 서울대 AI연구원 주요 연구진이 참여했다.

김명희 기자 noprint@etnews.com

![[1년전 오늘] 오픈AI, 새 AI 모델 GPT-4o 출시](https://www.jeonmae.co.kr/news/photo/202505/1145625_852177_2617.jpg)