메타가 제품을 업데이트할 때 위험 평가를 인간이 아닌 AI로 대체한다. AI 자동화로 인스타그램, 페이스북 등 새로운 기능 출시를 더욱 빠르게 하겠다는 의도다.

5월 31일(현지시각) 미국 공영 라디오(NPR)에 따르면 메타는 수년간 인간이 평가해 오던 신규 기능에 대한 위험성 평가를 앞으로 90%까지 AI로 대체할 예정이다.

메타는 자사 제품을 업데이트할 때 개인 정보 침해 위험성, 미성년자에게 해를 끼칠 가능성, 오해의 소지나 유해한 콘텐츠 여부 등을 검토한다. 제품의 잠재적 위험을 평가하는 ‘개인정보 보호 및 무결성 검토’ 작업은 인간 평가자가 모두 진행해 왔다.

NPR가 입수한 내부 문건에 따르면, 앞으로 메타는 제품 위험 평가를 AI로 자동화해 의사 결정을 간소화하고 제품 출시를 신속하게 할 예정이다. 즉, 메타 알고리즘에 대한 중요한 업데이트나 새로운 기능, 플랫폼에서 콘텐츠를 공유하는 방법에 대한 변경 사항 등을 AI 시스템이 승인하도록 바뀐다.

메타는 제품 위험 검토 변경과 관련해 “새롭고 복잡한 문제에는 여전히 인간의 전문 지식을 사용한다”며, “위험도가 낮은 의사 결정만 자동화한다”고 입장을 밝혔다.

케이티 하바스 전 페이스북 공공 정책 책임자는 “자동화 시스템을 사용해 잠재적 위험을 표시하면 중복되는 작업을 줄이는 데 도움이 될 수 있다”며, “빠르게 움직이면서도 높은 품질을 유지하려면 AI를 더 많이 도입해야 한다”고 주장했다.

하지만 NPR은 “메타가 AI 안전, 청소년 위험, 폭력적인 콘텐츠 및 허위사실 유포 등 모든 분야에서 AI로 검토하고 자동화하는 방안을 고려 중”이라고 내부 문건을 통해 확인했다.

메타 전·현직 직원들 사이에서 AI 기반 제품 위험 평가에 대한 부정적인 목소리도 나온다.

익명을 요구한 한 메타의 전 임원은 “이 과정은 기능적으로 더 많은 제품을 빠르게 출시하겠지만, 엄격한 심사와 반대에 부딪히지 않기 때문에 더 큰 위험을 초래한다”고 우려했다. 그는 이어 “제품 변경으로 인한 부정적인 외부 효과는 세상에 문제를 일으키기 전에 예방하기 어렵다”고 덧붙였다.

또, 위험 검토 과정에 참여하는 현직 직원은 “우리가 존재하는 이유를 생각하면 상당히 무책임한 일이라고 생각한다”며, “우리는 일이 어떻게 잘못될 수 있는지에 대한 인간적인 관점을 제공한다”고 지적했다.

글. 바이라인네트워크

<최가람 기자> ggchoi@byline.network

![[기고] 생성형 AI 진화와 계산 에이전트 시대 도래](https://img.etnews.com/news/article/2025/06/02/news-p.v1.20250602.f271cd093a1e445895ba6c44b6f48913_P3.jpg)

![[人사이트] 최명진 한컴인스페이스 대표 “Multi-INT 기반 실시간 분석 플랫폼으로 세계 시장 정조준”](https://img.etnews.com/news/article/2025/05/30/news-p.v1.20250530.5f673e3148c54b8596a992fc4a7ee22f_P2.jpg)

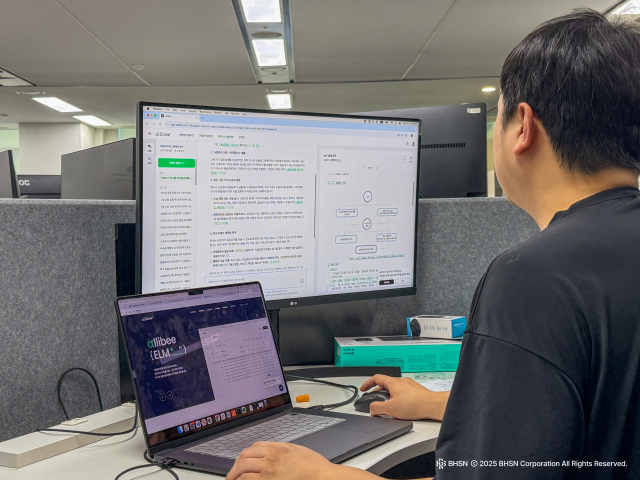

![[ET톡]리걸테크 가이드라인 첫삽](https://img.etnews.com/news/article/2025/06/02/news-p.v1.20250602.d3a85b404b894e1cb40d7e0b772184fb_P3.jpg)

![[이재명 노믹스] AI 중심 6G 추진·망사용료 제도화 '속도'](https://img.newspim.com/news/2025/06/04/250604104349035_w.jpg)